4. Ders

advertisement

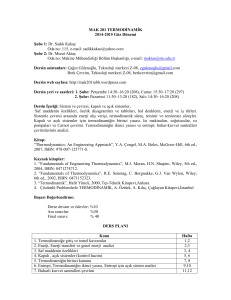

ENTR0PĐ

Entropi kavramı, makroskopik görüş açısından (klasik termodinamik), mikroskopik görüş

açısından (istatistiksel termodinamik) ve informasyon görüş açısından (informasyon teorisi) olmak

üzere, üç şekilde ele alınabilir. Entropinin istatistiksel tanımlanması daha esaslıdır. Diğer

tanımlamalar ve entropi ile ilgili tüm özellikler ondan çıkartılabilmektedir. Entropi tanımına

geçmeden önce bazı hatırlatmalar yapalım.

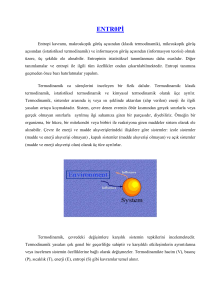

Termodinamik ısı süreçlerini inceleyen bir fizik dalıdır. Termodinamik: klasik

termodinamik, istatistiksel termodinamik ve kimyasal termodinamik olarak üçe ayrılır.

Termodinamik, sistemler arasında iş veya ısı şeklinde aktarılan (alıp verilen) enerji ile ilgili

yasaları ortaya koymaktadır. Sistem, çevre denen evrenin öbür kısmından gerçek sınırlarla veya

gerçek olmayan sınırlarla ayrılmış ilgi sahamıza giren bir parçasıdır, diyebiliriz. Örneğin bir

organizma, bir hücre, bir mitokondri veya birbiri ile reaksiyona giren maddeler sistem olarak ele

alınabilir. Çevre ile enerji ve madde alışverişlerindeki ilişkilere göre sistemler: izole sistemler

(madde ve enerji alışverişi olmayan) , kapalı sistemler (madde alışverişi olmayan) ve açık sistemler

(madde ve enerji alışverişi olan) olarak üç türe ayrılırlar.

Termodinamik, çevredeki değişimlere karşılık sistemin tepkilerini incelemektedir.

Termodinamik yasaları çok genel bir geçerliliğe sahiptir ve karşılıklı etkileşimlerin ayrıntılarına

veya incelenen sistemin özelliklerine bağlı olarak değişmezler. Termodinamikte hacim (V), basınç

(P), sıcaklık (T), enerji (E), entropi (S) gibi kavramlar temel alınır.

Termodinamiğin Yasaları:

•

Termodinamiğin sıfırıncı yasası: Đki termodinamik sistemin her biri üçüncü bir sistemle

termodinamik dengede ise aralarında da termodinamik dengededirler.

•

Termodinamiğin birinci yasası: Bir sistemin iç enerjisindeki artış, sisteme verilen ısı ile,

sistemin çevresine uyguladığı iş arasındaki farktır. Bu yasa "enerjinin korunumu" olarak

da bilinir.

•

Termodinamiğin ikinci yasası : “Entropi, bir termodinamik sistemden başka sistemlere iş

şeklinde aktarılması imkânsız enerji miktarı” olmak üzere, izole bir termodinamik sistemin

entropisi zamanla artmaktadır.

•

Termodinamiğin üçüncü yasası: Mutlak sıcaklıkta entropi sıfırdır. Bu yasa neden bir

maddeyi mutlak sıfıra kadar soğutmanın imkânsız olduğunu belirtir.

Termodinamiğin ikinci yasasında yer alan entropi, ısı enerjisinin tamamının mekanik işe

dönüştürülmesinin imkânsız olduğunu ifade eden termodinamik bir niceliktir. Sistemdeki

düzensizlik arttıkça, sistemin entropisi artar, yani sistemin faydalı iş verme kabiliyeti azalır. Bir su

damlası ısıtıldığında buharlaşır ve molekülleri daha düzensiz bir hal alır. T sıcaklığındaki bir cisme

∆Q kadarcık bir ısı verdildiğinde, entropisi ∆S=∆Q/T kadar artar. Entropi’ye, izole bir sistem

içindeki düzensizlik derecesi olarak da bakılabilir.

Termodinamiğin ikinci yasasına göre, izole sistemlerin entropisi artmaktadır. Entropinin

artması bir “geriye döndürülemez olay”dır. Kainatta her sistemin ve canlının entropisi devamlı

artmaktadır. Bu artış ilelebet devam etmeyecek, maksimuma erişince işe yarar enerji

kalmayacaktır. Đşe yarar enerjinin kalmaması demek, maddeler arasında ısı bakımından dengenin

sağlanması demektir.

Diğer yandan termodinamik aynı zamanda istatistiksel kavramlar kullanılarak da ifade

edilebilir. Mekanik (klasik veya kuantum) yasalarının istatistikle birleştirilerek kullanılması

sayesinde

geliştirilen

"istatistiksel

mekanik"

veya

"istatistiksel

termodinamik",

klasik

termodinamiğin tarif ettiği ancak açıklayamadığı bazı olgulara derin açıklamalar da getirmiştir.

Đstatistiksel mekanik; herbir atom ve molekülün mikroskopik özellikleriyle, günlük hayatta

karşılaşılan maddelerin makroskopik özellikleri arasında ilişki kurar. Bunu nesnelerin

termodinamik özelliklerini, moleküllerin spektroskopik (tayfölçüm) yöntemlerle alınmış verileri

kullanarak yapar. Đstatistiksel mekanikte bir sistemin dengede olması, onun bir makrodurumda

olduğunu (S) ifade etmekte olup, mikroskopik düzeyde ise olabilen tüm mikroskopik durumlar

arasında (sayıları Ω tane) geçişler yapmakta olduğunu ifade etmektedir. Böyle bir sistemin

entropisi, Boltzmann tarafından önerilen,

S = k log Ω

formülü ile hesaplanmaktadır. Entropi (S) bir sistemin girebileceği mikroskopik durumların

sayısına ( Ω ) bağlı olarak tanımlanmıştır. Burada k = 1.3806505 × 10−23 J K-1 Boltzmann sabiti’dir.

Sözü edilen mikroskopik durumların tanımı ve sayılması ise, sistemi oluşturan atomları tarif eden

temel mekanik yasalar kullanılarak yapılır.

Termodinamiğin çoğu uygulamasında, bir ya da daha çok değişken sabit tutulurken,

diğer değişkenlerin bunlara göre nasıl değiştiği incelenir ve bu da sistemin matematiksel

olarak (n sabit tutulmayan değişkenlerin sayısı olmak üzere) n boyutlu bir uzay olarak tarif

edilebileceği anlamına gelir. Đstatistiksel mekaniği fizik yasalarıyla birleştirerek, bu

değişkenleri birbirleri cinsinden ifade edecek "durum denklemleri" yazılabilir. Bunların en

basit ve en önemli olanlarından biri ise ideal gaz yasasıdır.

Bu denklemde R evrensel gaz sabiti'dir. Ayrıca istatistiksel mekanik terimleriyle bu denklem

şöyle yazılır:

Bu denklemde de k Boltzmann sabiti'dir.

Termodinamik değişkenler vasıtasıyla dört tane termodinamik potansiyel tanımlanabilir:

Sistemin Đç Enerjisi

Helmholtz Serbest Enerjisi

Gibbs Serbest Enerjisi

Entalpi

U : dU = T .dS + V .dP

Entalpi,özel bir fonksiyondur.Basınç sabit olduğu zaman bize ısıyı verir. Bu dört potansiyelin

diferansiyel denklemlerini ve zincirleme türev kuralını kullanarak bu dört potansiyel,

değişkenler ve birbirleri cinsinden yazılabilir:

E = U − P.V = A + T .S

A = E − T .S = G − P.V

G = A + P.V = U − T .S

U = G + T .S = E + P.V

Bu derste entropi kavramını enformasyon (informasyon, information) kavramı ile birlikte

kullanacağız. Enformasyon Teorisinin (Bilgi Kuramının) amacı bilginin elde edilmesi (haberin

alınması), aktarılması, işlenmesi ve saklanmasına ilişkin nicel kanunları incelemektir. Bilgi

kavramının tanımından önce, olasılık dağılımları üzerinde çeşitlilik ölçüsü olarak tanımlanan ve

istatistik entropi de denen entropi kavramının tanımını hatırlatmaya çalışacağız.

Entropi kavramı, kapalı bir kaptaki ideal bir gazın düzensizliğinin bir ölçüsü olarak 19.

yüzyılın sonlarında Boltzman tarafından ortaya atılan bir kavramdır. Bilgi kuramı 1940 ‘lı yıllarda

telekomünikasyona bağlı problemlerin çözümü sırasında ortaya çıkmıştır. Bilgi kuramının amacı

bilginin elde edilmesi, aktarılması, işlenmesi ve saklanmasına ilişkin kuralları incelemektir.

Bilginin aktarılması sürecindeki rasgelelik olgusu bu süreçlerin incelenmesinde istatistik

yöntemlerin kullanılmasını kaçınılmaz kılmaktadır.

Bilginin aktarılması için uygun biçimde kodlanmış olması gerekir. Bilgi minimum sayıda

sembol yardımıyla aktarılmalıdır. Bir maddesel sistemin durumu kesinkes biliniyorsa, bunun

hakkında aktarılan bilgi çokta değerli değildir. Buna göre, gelişigüzel olarak herhangi bir durumda

bulunan bir sisteme ilişkin alınan bir bilginin ne kadar değerli olduğunu ölçmeye yarayan bir kriter

olmalıdır. Buna sistemin “kararsızlık derecesi” denir. Bir sistemin kararsızlık derecesi sadece

mümkün olan durum sayısı ile değil; o durumda bulunma olasılıkları ile bağlantılıdır.

Gelişigüzellik (rasgelelik) içeren bir sistemin (X) bulunabileceği durumlar x1 , x2 ,..., xn olsun. Her

bir durumun olasılığı pi = P ( X = xi ) olmak üzere, sistem

x1 , x2 ,..., xn

X ≡

p1 , p2 ,..., pn

olarak gösterilsin. Sistem,

x1 , x2 ,..., xn ,...

X ≡

p1 , p2 ,..., pn ,...

biçiminde de olabilir. Kesikli durumlarda bulunabilen bir sistem (X) için durumlar x1 , x2 ,..., xn

olarak sayısallaştırılmış ise sistem bir X rasgele değişken olarak da ele alınabilir. X rasgele

değişkeninin olasılık fonksiyonu,

f X ( xi ) = P ( X = xi ) = pi , i = 1, 2,..., n

olsun. W = − log( f X ( X )) olarak tanımlanan W rasgele değişkeninin olasılık tablosu,

wi = − log( f X ( xi ))

− log( f X ( x1 ))

− log( f X ( x2 ))

⋯

− log( f X ( xn ))

− log p1

− log p2

⋯

− log pn

p1

p2

⋯

pn

wi = − log pi

fW ( wi ) = P (Wi = wi )

olmak üzere,

n

n

i =1

i =1

E (W ) = E (− log f X ( X )) = −∑ pi log f X ( xi ) = −∑ pi log pi

dır.

x1 , x2 ,..., xn

Kesikli durumlarda bulunabilen bir X ≡

sisteminin entropisi,

p1 , p2 ,..., pn

n

H ( X ) = −∑ pi log pi

i =1

olarak tanımlanır. Bu sistemi bir X rasgele değişkeni (rasgele değişkenin aldığı değerler

sistemin bulunabileceği durumlar) olarak da ele alabiliriz.

Entropi tanımındaki logaritmanın tabanı genellikle 2 olarak alınır. Bu durumda,

Durumlar

pi = P ( X = xi )

x1

p1 =

x2

1

2

p2 =

1

2

gibi bir sistemin entropisi,

2

1

1 1

1

H ( X ) = −∑ pi log 2 pi = −( log 2 + log 2 )

2

2 2

2

i =1

1

1

= −(− log 2 2 − log 2 2) = 1

2

2

olur. Entropinin tanımında logaritmanın tabanı 2 olarak seçildiğinde, eşit olasılıklı iki durumlu bir

sistemin entropisi, entropi ölçü birimidir. Birim entropiye “bit” denir. Örneğin, düzgün bir paranın

üç kez atılışındaki olasılıklara sahip, 8 durumlu bir sistemin entropisi,

YYY

YYT

YTY

TYY

YTT

TYT

TTY

TTT

1/8

1/8

1/8

1/8

1/8

1/8

1/8

1/8

1

1

H = − ( log 2 )8 = 3 (bit)

8

8

dır. N tane eşit olasılıklı durum gösteren bir sistemin entropisi log 2 N bit’tir. Sadece bir durumda

bulunan bir sistemin entropisi sıfırdır.

Örnek 1 Bir X sistemi (rasgele değişkeni) ile ilgili durumlar ve bu durumlarda bulunma

olasılıkları aşağıdaki gibi olsun.

1, 2 , 3, 4

X ≡1 1 1 1

, , ,

4 4 4 4

Bu sitemin entropisi,

4

1

1 1

1 1

1 1

1

H ( X ) = −∑ pi log 2 pi = − log 2 − log 2 − log 2 − log 2 =2 (bit)

4

4 4

4 4

4 4

4

i =1

dir. Entropi hesabında sadece durumların olasılıkları önemlidir. Sistem gösteriminde durumları

yazmasak da olur.

1 3 3 1

X ≡ , , ,

8 8 8 8

sisteminin entropisi

4

1

1 3

3 3

3 1

1

H ( X ) = − ∑ pi log 2 pi = − log 2 − log 2 − log 2 − log 2 =1.8 (bit)

8

8 8

8 8

8 8

8

i =1

dir.

Dört durumlu başka bir

1

1 97 1

X ≡

,

,

,

100 100 100 100

sisteminin entropisi,

4

H ( X ) = −∑ pi log 2 pi = −

i =1

1

1

97

97

1

1

1

1

log 2

−

log 2

−

log 2

−

log 2

100

100 100

100 100

100 100

100

=0.24 (bit)

dir. Düzgün dağılım durumunda entropinin en fazla olduğuna dikkat edin.

Entropi tanımında iki tabanlı logaritma yerine e tabanlı logaritma da kullanılmaktadır.

n

n

i =1

i =1

−∑ pi ln pi = −∑ pi ln(2

log 2 pi

n

n

i =1

i =1

) = −∑ pi log 2 pi ln(2) = − ln(2)∑ pi log 2 pi

Entropi ölçü birimi bit olmak üzere, entropi tanımında iki tabanlı logaritma yerine e tabanlı

logaritma kullanılırsa ln(2) katsayısını göz önünde tutmak gerekir. Doğal logaritma ve e tabanlı

üslü ifadelerin türev ve integral hesaplamaları daha kolay olmaktadır. Bundan sonraki kısımda bir

x1 , x2 ,..., xn

X ≡

sisteminin entropisi,

p1 , p2 ,..., pn

n

H ( X ) = −∑ pi ln pi

i =1

olarak tanımlanacaktır.

Khinchin Teoremi: Sonlu sayıda durum gösteren bir sistemin entropisinin maksimum değeri

durum sayısının logaritmasına eşittir ve durum olasılıklarının eşit olduğu halde ortaya

çıkmaktadır.

Đspat: Sistemin n tane durumu olsun.

x1 , x2 ,..., xn

X ≡

,

p1 , p2 ,..., pn

i = 1, 2,..., n için pi > 0 ve

n

∑p

i =1

i

=1

sisteminin,

n

H ( X ) = H ( p1 , p2 ,..., pn ) = −∑ pi ln pi

i =1

entropisini maksimum değerini bulmak için,

n

Amaç :

max H ( p1 , p2 ,..., pn ) = − ∑ pi ln pi

i =1

n

Kısıtlar :

∑p

i =1

i

=1

pi > 0 , i = 1, 2,..., n

optimizasyon problemini ele alalım.

Problemi Lagrange çarpanları yöntemi ile çözmeye çalışalım. Lagrange fonksiyonu,

n

n

i =1

i =1

L = −∑ pi ln pi + λ (∑ pi − 1)

ve

∂L

= − ln pi − 1 + λ , i = 1, 2,..., n

∂pi

n

∂L

= ∑ pi − 1

∂λ i =1

olmak üzere, türevlerin sıfıra eşitlenmesiyle elde edilen denklem sistemi,

− ln p = 1 − λ

1

− ln p2 = 1 − λ

⋮

− ln p = 1 − λ

n

n

∑ pi = 1

i =1

olup, denklem sisteminin çözümü

p1 = p2 = ... = pn =

λ = 1 + ln

1

n

1

n

ve

n

1 1

1

max H ( p1 , p2 ,..., pn ) = −∑ ln = − ln = ln n

n

n

i =1 n

dır. Sonlu sayıda duruma sahip sistemlerde maksimum entropi, durum olasılıklarının eşit

olduğunda ortaya çıkmaktadır ve n durumlu bir sistemin maksimum entropisi ln n dir.

x1 , x2 ,..., xn

X =

sisteminin her durumu için belli bir enerji düzeyi (değeri) söz konusu

p1 , p2 ,..., pn

olsun. Sistem kendi durumlarında p1 , p2 ,..., pn olasılıkları ile bulunmaktadır. Sistemin enerji

düzeyleri ve bu düzeylerde bulunması olasılıkları,

E

E1

E2

...

En

f E ( Ei ) = P( E = Ei )

p1

p2

...

pn

olmak üzere enerji ortalaması, yani enerjinin beklenen değeri

n

µ E = ∑ Ei pi

i =1

dır.

Sonlu durumlu ve enerji düzeyleri E1 , E2 ,..., En olan sistemin ortalama enerjisi belli bir

n

değere eşit

∑E p

i =1

i

i

= µ E* olacak şekilde maksimum entropili sistem hangisidir ve entropisi nedir?

Başka bir ifade ile,

n

Amaç :

max H ( p1 , p2 ,..., pn ) = − ∑ pi ln pi

i =1

n

Kısıtlar :

∑p

i =1

i

=1

n

∑E p

i =1

i

i

= µ E*

pi > 0 , i = 1, 2,..., n

probleminin çözümü nedir?

Lagrange fonksiyonu,

n

n

n

i =1

i =1

i =1

L = −∑ pi ln pi + λ1 (∑ Ei pi − µ E* ) + λ2 (∑ pi − 1)

ve

∂L

= − ln pi − 1 + λ1 E1 + λ2 , i = 1, 2,..., n

∂pi

n

∂L

= ∑ Ei pi − µ E*

∂λ1 i =1

n

∂L

= ∑ pi − 1

∂λ2 i =1

olmak üzere, türevlerin sıfıra eşitlenmesiyle elde edilen denklem sistemi,

− ln p1 = 1 − λ1 E1 − λ2

− ln p = 1 − λ E − λ

2

1 2

2

⋮

− ln pn = 1 − λ1 En − λ2

n

E p = µ*

i i

E

∑

i =1

n

p =1

i

∑

i =1

veya

p = e1−λ1E1 −λ2

1

p = e1−λ1E2 −λ2

2

⋮

p = e1−λ1En −λ2

n

n

Ei pi = µ E*

i =1

n

pi = 1

i =1

∑

∑

olup, ilk n denklemin toplamından

1=

e

n

e1−λ −λ E

∑

i =1

1 i

2

λ2 −1

=

n

e− λ E

∑

i =1

1 i

n

λ2 − 1 = ln(∑ e

− λ1Ei

)

i =1

elde edilir.

n

µ E* = ∑ Ei pi =

e

λ2 −1

i =1

n

n

Ei pi ∑ e

∑

i =1

i =1

eλ2 −1

=

λ2 −1

n

pi Ei

eλ2 −1

=

e

∑

i =1

− λ1Ei

eλ2 −1

n

Ei

e−λ E Ei

∑

i =1

1

=

i

n

∑ e−λ1E

=−

i

∂ n − λ1Ei

ln e

∂λ1 i =1

∑

i =1

olmak üzere,

1−λ1Ei −λ2

pi = e

1−λ2 −λ1Ei

=e

−λ E

e−λ1Ei

e 1 i

= λ −1 = n

, i=1,2,...,n

− λ1Ei

e2

∑e

i =1

elde edilir. Buna göre,

H max = −

n

∑ pi ln pi

i =1

= λ2 − 1 + λ1µ E*

dır.

−λ1Ei

e

= − pi ln n

−λ1Ei

i =1

∑e

j =1

n

∑

n

=−

i =1

n

n

i =1

i =1

∑ pi ( ln e−λ1Ei − (λ2 −1) ) = (λ2 −1)∑ pi + λ1 ∑ pi Ei

x1 , x2 ,..., xn

Sonlu durumlu X ≡

gibi bir sistemin enerji düzeyleri E1 , E2 ,..., En olduğunda,

p1 , p2 ,..., pn

n

sistemin ortalama enerjisi belli bir

∑E p

i =1

i

i

= µ E* değerine eşit olacak şekilde maksimum

entropili sistemin durum olasılıkları

pi =

e

− λ1Ei

n

∑e

− λ1Ei

, i=1,2,...,n

i =1

dır. Gazların Kinetik teorisinden,

pi =

e

n

Ei

− kT

∑e

−

Ei

kT

, i=1,2,...,n

i =1

dir (T mutlak sıcaklığı ve k Boltzmann sabitini göstermektedir). Buna göre, sistemin

n

ortalama enerjisi belli bir

∑E p

i

i =1

i

= µ E* değerine eşit olacak şekilde maksimum entropili

sistemde enerji düzeylerinin olasılık dağılımı,

E

E1

f E ( Ei ) = P( E = Ei )

e

p1 =

...

E2

− E1

n

kT

∑e

−

Ei

kT

p2 =

i =1

e

n

− E2

kT

∑e

−

En

...

pn =

Ei

kT

e

n

En

− kT

∑e

−

Ei

kT

i =1

i =1

dır. Bu olasılık dağılımına Boltzmann Dağılımı denir.

Metropolis-Hastings Algoritmasında olduğu gibi uygulamalarda k sabiti göz ardı

edilip,

E

E1

E

f E ( Ei ) = P( E = Ei )

p1 =

e

n

− T1

∑e

i =1

...

E2

−

Ei

T

E

p2 =

e

n

− T2

∑e

−

Ei

T

i =1

dağılımı kullanılmaktadır. Bu dağılıma Gibbs dağılımı denir.

En

...

pn =

e

n

− En

∑e

i =1

T

−

Ei

T

Đki ya da daha çok sistemin bileşkesi olan sistemlerde entropi kavaramını ele alalım.

x1 , x2 ,..., xn

X ≡

p1 , p2 ,..., pn

ve

y1 , y2 ,..., ym

Y ≡

r1 , r2 ,..., rm

gibi iki sistem söz konusu olsun. Bu iki sistemin bileşkesi dendiğinde,

{( xi , y j ) : i = 1, 2,..., n , j = 1, 2,..., m}

kümesindeki durumlarda bulunabilen sistem anlaşılmaktadır. X ve Y gibi iki sistemin bileşkesi olan

sistemi ( X , Y ) biçiminde gösterelim. Bu sistemin ( xi , y j ) , i = 1, 2,..., n , j = 1, 2,..., m

durumlarında bulunması olasılıkları P ( X = xi , Y = y j ), i = 1, 2,..., n , j = 1, 2,..., m olsun. Bileşke

sistemin entropisi,

n

H ( X , Y ) = −∑

i =1

m

∑ P( X = x , Y = y ) ln P( X = x , Y = y )

j =1

i

j

i

j

olarak tanımlanmaktadır. Đki sistem birbirinden bağımsız, yani

P ( X = xi , Y = y j ) = P ( X = xi ) P (Y = y j )

olduğunda,

ln P ( X = xi , Y = y j ) = ln P ( X = xi ) + ln P (Y = y j )

olmak üzere,

H ( X , Y ) = H ( X ) + H (Y )

dır. Bağımsız iki sistemin bileşkesinin entropisi, sistemlerin entropi toplamlarına eşittir.

( X , Y ) gibi bileşik bir sistemde, X sisteminin xi durumunda olduğu bilinsin. X sisteminin

xi durumunda olduğu bilindiğinde Y sisteminin koşullu entropisi

m

Y = y j

Y = y j

H (Y / X = xi ) = −∑ P

ln P

X

=

x

X

=

x

i

i

j =1

olarak tanımlanır.

( X , Y ) gibi bileşik bir sistemde, Y sisteminin X sistemine koşullu toplam entropisi

n

H (Y / X ) = ∑ pi H (Y / X = xi )

i =1

olarak tanımlanmaktadır.

( X , Y ) bileşke sisteminde Y sistemi ile X sistemi bağımsız ise

n

n

m

Y = y j

Y = y j

H (Y / X ) = ∑ pi H (Y / X = xi ) = −∑ pi ∑ P

ln P

X

=

x

X

=

x

i

i

i =1

i =1

j =1

= −∑ pi ∑ P (Y = y j ) ln P (Y = y j ) = −∑ P (Y = y j ) ln P (Y = y j )

n

m

m

i =1

j =1

j =1

= H (Y )

dır.

( X , Y ) bileşke sisteminin entropisi için

H ( X , Y ) = H ( X ) + H (Y / X ) = H (Y ) + H ( X / Y )

Y = y j

yazılabilir ( P ( X = xi , Y = y j ) = P ( X = xi ) P

den kolayca elde edilir). Ayrıca,

X = xi

H ( X , Y ) ≤ H ( X ) + H (Y )

dır.

Dikkat edilirse iki bileşenli bir sistem, iki değişkenli bir rasgele vektör olarak ele alınabilir.

Bundan sonra, ( X , Y ) bileşke sistemi ile ( X , Y ) rasgele vektörü kavramlarını birbirinin yerine

kullanacağız. ( X , Y ) nin olasılık fonksiyonu

f X ,Y ( xi , y j ) = pij = P ( X = xi , Y = y j ) , i = 1, 2,..., n , j = 1, 2,..., m

olmak üzere ( X , Y ) sistemi, entropi açısından pij , i = 1, 2,..., n , j = 1, 2,..., m

olasılıkları ile

anlatılabilir, yani ( X , Y ) ≡ ( pij )n×m diyebiliriz. Buna göre; X , Y rasgele değişkenlerinin ortak

dağılımının entropisi ( X ve Y sistemlerinin bileşkesinin entropisi)

n

H ( X , Y ) = −∑

i =1

m

∑p

j =1

ij

ln pij

dır.

Örnek 2 a) ( X , Y ) gibi bileşik bir sistem (iki boyutlu rasgele vektör) ile ilgili durumlar ve bu

durumlarda bulunması olasılıkları aşağıdaki gibi olsun.

Y

X

x1

x2

y1

1/4

1/4

y2

1/4

1/4

Bu bileşke sistemin entropisi,

1 1 1 1 1 1 1 1

H ( X , Y ) = − ln − ln − ln − ln = ln 4 = 2 ln 2 = 2(bit )

4 4 4 4 4 4 4 4

olup, X sisteminin (X rasgele değişkeninin) entropisi,

1 1 1 1

H ( X ) = − ln − ln = ln 2 = 1(bit )

2 2 2 2

Y sisteminin (Y rasgele değişkeninin) entropisi

1 1 1 1

H (Y ) = − ln − ln = ln 2 = 1(bit )

2 2 2 2

olmak üzere,

H ( X , Y ) = H ( X ) + H (Y )

dır.

b) ( X , Y ) gibi bileşik bir sistem (iki boyutlu rasgele vektör) ile ilgili durumlar ve bu durumlarda

bulunması olasılıkları aşağıdaki gibi olsun.

Y

X

x1

x2

y1

1/8

3/8

y2

3/8

1/8

Bu bileşke sistemin entropisi,

1 1 3 3 3 3 1 1

1.2555

(bit) = 1.8113 (bit)

H ( X , Y ) = − ln − ln − ln − ln = 1.2555 =

8 8 8 8 8 8 8 8

ln 2

olup, X sisteminin (X rasgele değişkeninin) entropisi,

1 1 1 1

H ( X ) = − ln − ln = ln 2 = 1(bit )

2 2 2 2

Y sisteminin (Y rasgele değişkeninin) entropisi

1 1 1 1

H (Y ) = − ln − ln = ln 2 = 1(bit )

2 2 2 2

olmak üzere,

H ( X , Y ) ≤ H ( X ) + H (Y )

dır.

X sisteminin (rasgele değişkeninin) x1 durumunda olduğu bilindiğinde Y sisteminin (rasgele

değişkeninin) koşullu dağılımı

yj

y1

y2

Y = y j

P

X

=

x

1

1/4

3/4

ve koşullu entropisi,

2

1 1 3 3

Y = y j

Y = y j

H (Y / X = x1 ) = −∑ P

ln P

= − ln − ln = 0.562=0.811 (bit)

X

=

x

X

=

x

1

1

4 4 4 4

j =1

dır. Benzer şekilde X sisteminin (rasgele değişkeninin) x2 durumunda olduğu bilindiğinde Y

sisteminin (rasgele değişkeninin) koşullu entropisi,

2

3 3 1 1

Y = y j

Y = y j

H (Y / X = x2 ) = −∑ P

ln P

= − ln − ln = 0.562=0.811 (bit)

X = x2

X = x2

4 4 4 4

j =1

dır.

Y sisteminin X sistemine koşullu toplam entropisi,

2

1

1

H (Y / X ) = ∑ pi H (Y / X = xi ) = × 0.811 + × 0.811 = 0.811(bit )

2

2

i =1

dır.

Durum Uzayı Sürekli Olan Sistemlerin Entropisi

x1 , x2 ,..., xn

Kesikli durumlarda bulunabilen bir X ≡

sisteminin entropisi,

p

p

p

,

,...,

n

1

2

n

H ( X ) = −∑ pi ln pi

i =1

olarak tanımlandı. Bu sistemi bir X rasgele değişkeni (rasgele değişkenin aldığı değerler sistemin

bulunabileceği durumlar) olarak da ele alabileceğimizi söyledik. Uygulamada sürekli rasgele

değişkene benzeyen maddesel sistemler de söz konusu olmaktadır. Bu tür sistemlerin durumları

sayılamaz çokluktadır. Durumların birinden diğerine sürekli tarzda geçilir, ancak sistemin herhangi

bir durumda bulunma olasılığı sıfırdır, sürekli rasgele değişkenlerde olduğu gibi. Durumlarının

kümesi reel sayılar ile eşlenebilen sürekli bir X sisteminin (sürekli bir rasgele değişkenin) bir

aralıkta bulunması olasılığı, bir olasılık yoğunluk fonksiyonu yardımıyla,

P ( x1 < X < x2 ) = P ( x1 ≤ X ≤ x2 ) = P ( x1 < X ≤ x2 ) = P ( x1 ≤ X < x2 ) =

x2

∫ f ( x)dx

x1

olarak ifade edilebilir. Sürekli sistem kavramı, tıpkı sürekli rasgele değişken kavramı gibi bir

idealleştirmedir. Bir insanın boy uzunluğu sürekli bir rasgele değişkendir deriz, ama bu teorik

olarak doğrudur. Gerçekte bir insanın boyu 1 cm den daha küçük bir kesimle ölçülmez ve boy

ölçüleri hiçbir zaman 1 mm farkla ifade edilmez. Olsa olsa boylar 1 cm farkla birbirinden ayrılır.

Buna benzer biçimde, ölçmelerde bir duyarlılık sınırı kabul ederek, yani bir △ x değeri belirlenerek

sürekli sistem (sürekli rasgele değişken) kesikli sisteme (kesikli rasgele değişkene) indirgenebilir.

Örneğin sürekli sistemin durumları (sürekli rasgele değişkenin aldığı değerler) bir ( a, b ) ⊂ R

aralığında ise bu aralık, a = x1 < x2 < x3 < ... < xn = b , xi +1 = xi +△ x , i = 1, 2,3,..., n − 1 noktaları ile

olacak

( a, b ) = ( x1 , x2 ] ∪ ( x2 , x3 ] ∪ ( x3 , x4 ] ∪ ... ∪ ( xn −1 , xn ] ∪ ( xn , xn +1 )

şekilde ( x1 , x2 ] , ( x2 , x3 ] , ( x3 , x4 ] ,...., ( xn −1 , xn ] , ( xn , xn +1 )

aralıklarına

ayrılabilir. Bu

aralıkların kendileri sistem durumu olarak alınırsa karşımıza n durumlu kesikli bir sistem çıkar. ∆x

değeri yeterince küçük tutulduğunda,

P( xi < X ≤ xi +1 ) = P( xi < X ≤ xi + ∆x) =

xi + △ x

∫

x

f ( xi )dx ≈ f ( xi )∆x

i

olmak üzere,

entropsi,

( x1 , x2 ] , ( x2 , x3 ] , ( x3 , x4 ] ,...., ( xn −1 , xn ] , ( xn , xn +1 )

n

n

i =1

i =1

n

durumlarında bulunabilen sistemin

n

n

i =1

i =1

−∑ pi ln pi = − ∑ f ( xi )△ x ln ( f ( xi )△ x ) = − ∑ f ( xi )△ x ln f ( xi ) − ∑ f ( xi )△ x ln△ x

n

= −∑ f ( xi )△ x ln f ( xi ) − ln△ x∑ f ( xi )△ x

i =1

i =1

dır.

n

b

f ( xi )△ x ln f ( xi ) → ∫ f ( x) ln f ( x)dx

∑

i =1

△ x →0

a

n

b

i =1

a

△ x →0

→ ∫ f ( x)dx = 1

∑ f ( xi )△x

olmak üzere, yeterince küçük ∆x için

n

n

n

b

i =1

i =1

i =1

a

−∑ pi ln pi = − ∑ f ( xi )∆x ln f ( xi ) − ln ∆x∑ f ( xi )∆x ≈ −∫ f ( x)ln f ( x)dx − ln ∆x

dır.

Sürekli bir X sisteminin (sürekli bir rasgele X değişkeninin) entropisi, ölçme duyarlılığını

ifade eden ∆x değeri göz önünde tutularak,

H ∆x ( X ) = −

∫

D

f ( x)ln f ( x)dx − ln ∆x

X

olarak tanımlanmaktadır. DX kümesi X rasgele değişkeninin aldığı değerlrin kümesidir.

Sürekli bir sistemin,

H ∆x ( X ) = −

∫

D

f ( x)ln f ( x)dx − ln ∆x

X

entropi formülündeki birinci terim ∆x ‘den bağımsızdır. ∆x değeri sistem durumunun

belirlenmesindeki (ölçülmesindeki, gözlenmesindeki) yaklaşıklığı ifade eder.

Sürekli sistemler için entropi formülü daha basit bir biçimde,

H ∆x ( X ) = −

∫

f ( x)ln f ( x)dx − ln ∆x = − ∫ f ( x) ln[ f ( x)∆x]dx = E [ − ln[ f ( X )∆x]]

DX

DX

olarak da yazılabilir.

Örnek 3 a) X ∼ U (a, b) olduğunda,

H ∆x ( X ) = −

∫

b

1

1

b−a

ln

dx − ln ∆x = ln

b−a b−a

∆x

a

f ( x)ln f ( x)dx − ln ∆x = − ∫

DX

b) X ∼ N (0, σ X2 ) olduğunda,

H ∆x ( X ) = −

∫

∞

f ( x)ln f ( x)dx − ln ∆x = − ∫

−∞

DX

∞

1

x2

1 − 2σX2 x 2

dx + ln

e

2σ X2

2π

=

∫

−∞

=

1

+ ln

2

(

(

2πσ X

−

e

x2

2σX2

x

1

− 2

2σ X

ln

e

2πσ X

2

dx − ln ∆x

)

2πσ X − ln ∆x

)

2πσ X − ln ∆x

dır.

Örnek 4 Sürekli bir sistemin (rasgele değişkenin) olasılık yoğunluk fonksiyonu f X olduğunda

sistemin entropisi,

H ∆x ( X ) = −

∞

∫

f X ( x)ln f X ( x)dx − ln ∆x

−∞

dır.

Aşağıdaki,

f ( x) ≥ 0 , x ∈ R

∞

∫−∞ f ( x)dx = 1

∞

∫ xf ( x)dx = a

(a ∈ R ve a bir sabit sayı)

−∞

∞

∫ ( x − a)

−∞

2

f ( x)dx = b (b > 0 ve b bir sabit sayı)

özelliklerini sağlayan f fonksiyonları birer olasılık yoğunluk fonksiyonu olup, belirledikleri

dağılımların beklenen değer ve varyansları aynıdır. Beklenen değeri ve varyansı aynı olan sürekli

dağılımlar arasında entropisi en büyük olan dağılım hangisidir. Başka bir ifade ile,

∞

max(−

f

∫

f ( x)ln f ( x)dx − ln ∆x)

−∞

Kısıtlar: f ( x) ≥ 0 , x ∈ R

∞

∫

f ( x)dx = 1

−∞

∞

∫ xf ( x)dx = a

(a ∈ R ve a bir sabit sayı)

−∞

∞

∫ ( x − a)

−∞

2

f ( x)dx = b (b > 0 ve b bir sabit sayı)

optimizasyon probleminin çözümü nedir? Bu problem çözüldüğünde, ilginç bir şekilde karşımıza

beklenen değeri µ = a ve varyansı σ 2 = b olan N ( µ , σ 2 ) normal dağılımı çıkmaktadır.

X ve Y iki sürekli sistem (rasgele değişken) olsun. (X,Y) bileşik sisteminin, başka bir ifade

ile (X,Y) rasgele vektörünün olasılık yoğunluk fonksiyonu f X ,Y olsun. Ayrıca X ile Y bileşenlerinin

olasılık yoğunluk fonksiyonları f X , fY ve koşullu dağılımların olasılık yoğunluk fonksiyonları

f X / y , fY / x olsun. X ve Y ‘nin ölçme duyarlılıkları sırasıyla ∆x , ∆y olsun.

( X , Y ) bileşik sisteminin entropisi,

H ∆x∆y ( X , Y ) = E[− ln{ f ( X , Y )∆x∆y}]

olarak tanımlanmaktadır.

X ‘in x durumunda bulunduğu bilinirken Y ‘nin H (Y | x) kısmi koşullu entropisi

H ∆y (Y | x) = − ∫

∞

−∞

fY / x ( y ) ln fY / x ( y )dy − ln ∆y

ve H (Y | X ) ortalama koşullu entropi

H ∆y (Y | X ) = − ∫

∞

∫

∞

−∞ −∞

olarak tanımlanmaktadır.

f X ( x) fY / x ( y ) ln fY / x ( y )dxdy − ln ∆y

f X ,Y ( x, y ) = f X ( x). fY / x ( y )

eşitliğini dikkate alarak,

H ∆y (Y | X ) = − ∫

∞

∫

∞

−∞ −∞

= −∫

∞

∫

∞

−∞ −∞

f X ,Y ( x, y ) ln fY / x ( y )dxdy − ln ∆y

f X ,Y ( x, y ) ln{ fY / x ( y )∆y}dxdy

formülü elde edilir.

H ∆y (Y | X ) = E[− ln f (Y | X ) − ln ∆y ]

veya

H ∆y (Y | X ) = E[− ln{ f (Y | X )∆y}]

olarak yazılabilir.

( X , Y ) bileşik sisteminin entropisi,

H ∆x∆y ( X , Y ) = E[− ln{ f ( x, y )∆x∆y}]

olmak üzere,

f X ,Y ( x, y ) = f X ( x). fY / x ( y )

ifadesinden,

H ∆x∆y ( X , Y ) = E[− ln{ f ( x, y )∆x∆y}] = − ∫

∞

∫

∞

−∞ −∞

= −∫

∞

f X ,Y ( x, y ) ln{ f X ,Y ( x, y )∆x∆y}dxdy

∞

∫ f ( x, y ) ln{ f ( x) f ( y)∆x∆y}dxdy

= − ∫ ∫ f ( x, y ) ln{ f ( x)∆x}dxdy − ∫ ∫ f ( x, y ) ln{ f ( y )∆y}dxdy

= − ∫ f ( x) ln{ f ( x)∆x}dx − ∫ ∫ f ( x) f ( y ) ln{ f ( y )∆y}dxdy

= H ( X ) − ∫ f ( x) ∫ f ( y ) ln{ f ( y )∆y}dydx

−∞ −∞

∞

X ,Y

X

X ,Y

X

∞

−∞ −∞

∞

∞

−∞

X

X

−∞

∞

−∞ −∞

∞

∞

∆x

Y/x

X ,Y

Y/x

∞

−∞ −∞

X

Y /x

Y/x

∞

X

−∞

Y/x

Y /x

= H ∆x ( X ) + H ∆y (Y / X )

elde edilir. ( X , Y ) bileşik sistemin bileşenleri bağımsız olduğunda,

H ∆x∆y ( X , Y ) = H ∆x ( X ) + H ∆y (Y )

dır.

X1

X

2

Bileşen sayısı k ≥ 2 olmak üzere, k bileşenli bir X = sistemi (k boyutlu rasgele

⋮

Xk

vektörü) için entropi,

H ( X ) = − E f X ( X 1 , X 2 ,..., X k ) ln f X ( X 1 , X 2 ,..., X k )

larak tanımlanır. Bileşenler bağımsız olduğunda,

H ( X ) = H ( X 1 ) + H ( X 2 ) + ... + H ( X k )

dır. Genelde,

H ( X ) = H ( X 1 ) + H ( X 2 / X 1 ) + H ( X 3 / X 1 , X 2 ) + ... + H ( X k / X 1 , X 2 ,..., X k −1 )

dır. Sürekli durumda da yukarıdakilere benze tanımlamalar yapılabilir.